近期,,多地公安機關(guān)發(fā)布了多起利用AI工具實施造謠的相關(guān)案件。6月20日,,上海市公安局城市軌道和公交總隊官方微博@軌交幺幺零發(fā)布警情通報:兩名營銷人員為博取關(guān)注造謠地鐵站發(fā)生持刀傷人的情況,,被警方依法處以行政拘留。其中一人,,使用AI軟件生成視頻技術(shù),,編造了地鐵行兇的虛假視頻等不實信息發(fā)布到網(wǎng)上,造成惡劣社會影響,。

記者采訪了解到,,便利的AI工具大大降低了造謠的成本,,提升了謠言的數(shù)量級和傳播力。AI造謠呈現(xiàn)出門檻低,、批量化,、識別難等特點,亟待加強監(jiān)管,,斬斷背后利益鏈條,。

AI造謠頻發(fā)

記者梳理發(fā)現(xiàn),近年來,,AI造謠在全國多地頻發(fā),,傳播快、門檻低,、迷惑性強,。

去年,在上海一女童走失事件中,,一團伙以“標題黨”“震驚體”方式,,惡意編造炒作“女孩父親系繼父”“女孩被帶往溫州”等系列謠言。該團伙利用AI工具等生成謠言內(nèi)容,,通過114個賬號矩陣,,在6天內(nèi)發(fā)布268篇文章,多篇文章點擊量超過100萬次,。

AI造謠門檻很低,。一名辦案人員透露,此前在調(diào)查一起謠言案件時發(fā)現(xiàn),,謠言源頭來自中部某省份的一個村落,。經(jīng)調(diào)查,該村有大量村民利用生成式AI撰寫網(wǎng)絡文章,。

“部分村民通過口口相傳獲知,,把搜索到的網(wǎng)絡熱點信息粘貼進AI模型后,可以生成新文章,;在一些互聯(lián)網(wǎng)平臺上發(fā)布,即可通過流量賺錢,。不少村民都自發(fā)從事該活動,。”辦案人員說,。

迷惑性強,,也是AI造謠的一大特點。

公安部網(wǎng)安局近期公布一起案例,。2023年12月以來,,一條“西安市鄠邑區(qū)地下涌出熱水”的信息頻繁在網(wǎng)絡上傳播,,出現(xiàn)如“地下出熱水是因為發(fā)生了地震”“是因為地下熱管道破裂”等謠言。經(jīng)查,,相關(guān)謠言是通過AI洗稿方式生成的,。

記者發(fā)現(xiàn),上述謠言采用類似新聞的行文,,其中夾雜著“據(jù)報道”“相關(guān)部門正對事故原因進行深入調(diào)查,,并采取措施進行搶修”“提醒廣大市民在日常生活中要注意安全”等內(nèi)容。普通人難辨真?zhèn)巍?

清華大學新聞與傳播學院教授沈陽表示,,AI的介入使得信息的生成和傳播速度大大加快,,同時也增加了判斷信息真實性、準確性的難度,。AI工具從技術(shù)上降低了不法團伙造謠,、傳謠的門檻,大幅提升了謠言的數(shù)量級和傳播力,,可能促使網(wǎng)絡謠言“定制化”生成,、“精準化”傳播、“智能化”擴散,。

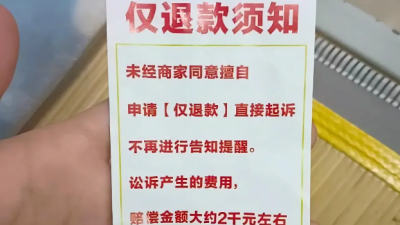

清華大學新聞與傳播學院新媒體研究中心今年4月發(fā)布的一份研究報告顯示,,近兩年的AI謠言中,經(jīng)濟與企業(yè)類謠言占比最高,,達43.71%,;近一年來,經(jīng)濟與企業(yè)類AI謠言量增速高達99.91%,,其中餐飲外賣,、快遞配送等行業(yè)更是AI謠言重災區(qū)。

流量牟利

記者發(fā)現(xiàn),,多起AI造謠事件背后,,造謠者的動機主要源于獲取互聯(lián)網(wǎng)內(nèi)容平臺給予創(chuàng)作者的點擊量、閱讀量獎勵,,以及為電商平臺經(jīng)營引流等,。

浙江省紹興市上虞區(qū)人民法院2023年宣判的一起案件中,不法分子為吸粉引流,,通過非法渠道購買AI視頻生成軟件,,將網(wǎng)上搜集的熱門話題,通過AI一鍵生成視頻,,并發(fā)至多個熱門視頻平臺上牟利,。

經(jīng)審查發(fā)現(xiàn),截至案發(fā),,不法分子發(fā)布的《浙江工業(yè)園現(xiàn)場大火濃煙滾滾,,目擊者稱有爆炸聲,!》等20余條虛假造謠視頻,涉及浙江,、湖南,、上海、四川等多個省市,,累計閱讀觀看量超過167萬次,。

記者調(diào)查發(fā)現(xiàn),在自媒體平臺上發(fā)布內(nèi)容,、博取流量已經(jīng)成為一門生意,。“圖文創(chuàng)作,,AI自動寫文章,,單號輕松日產(chǎn)500+,可多號操作,,小白輕松上手”“無需洗稿,,AI一天100篇原創(chuàng)”之類的文章在互聯(lián)網(wǎng)上廣為流傳。

以一家大型互聯(lián)網(wǎng)內(nèi)容平臺為例,,發(fā)布內(nèi)容基礎千次的閱讀單價為0.12元,,但通過一系列系數(shù)相乘,可以讓千次閱讀收益提高10倍,。這意味著如果一篇文章閱讀量達到100萬次,,創(chuàng)作者即能收益超過1000元。

一些人使用AI造謠的目的是為電商平臺產(chǎn)品銷售引流,。今年2月,,上海公安機關(guān)發(fā)現(xiàn),在一家電商平臺上出現(xiàn)了某藝人“命運多舛,、含恨離世”等短視頻,,引發(fā)大量點贊和轉(zhuǎn)發(fā)。

經(jīng)查,,該視頻內(nèi)容完全系偽造,。視頻發(fā)布者到案后交代,他在某電商平臺上經(jīng)營一家土特產(chǎn)網(wǎng)店,。由于銷量不佳,,他便通過編造奪人眼球的虛假新聞給網(wǎng)店賬號吸引流量。他不會視頻剪輯,,便利用AI技術(shù)生成文本和視頻,。

多管齊下強化治理

今年4月,中央網(wǎng)信辦秘書局發(fā)布《關(guān)于開展“清朗·整治‘自媒體’無底線博流量”專項行動的通知》,,要求加強信息來源標注展示,。使用AI等技術(shù)生成信息的,必須明確標注系技術(shù)生成,。發(fā)布含有虛構(gòu),、演繹等內(nèi)容的,必須明確加注虛構(gòu)標簽,。

專家表示,,隨著AI使用門檻降低,,AI造謠問題可能加劇,;建議壓實互聯(lián)網(wǎng)內(nèi)容平臺、AI內(nèi)容生成平臺等主體責任,,阻斷造謠背后的利益鏈條,;加強法律研究和適用,提高造謠者,、傳謠者的違法成本。

北京師范大學新聞傳播學院教授喻國明建議,,AI內(nèi)容生成平臺要進一步完善對生成內(nèi)容和內(nèi)容來源的標識機制,,例如附加不可刪除的數(shù)字水印和文本說明,?;ヂ?lián)網(wǎng)內(nèi)容平臺可接入AI內(nèi)容生成平臺的大模型系統(tǒng),實時進行數(shù)據(jù)識別比對,。

中國社會科學院大學互聯(lián)網(wǎng)法治研究中心主任劉曉春建議,,互聯(lián)網(wǎng)內(nèi)容平臺應加強對AI造謠行為的智能識別機制研究,進一步優(yōu)化涉及AI內(nèi)容的流量分發(fā)和收益分成機制,,壓縮別有用心者批量生產(chǎn)謠言的牟利空間,。

喻國明認為,,在辟謠方面,可利用AI辟謠應對AI造謠,,“針對被確認為謠言的內(nèi)容,互聯(lián)網(wǎng)內(nèi)容平臺可利用AI技術(shù)向曾經(jīng)瀏覽過相關(guān)內(nèi)容的用戶智能推送辟謠內(nèi)容或進行風險提示,,降低謠言破壞力?!?

沈陽等業(yè)內(nèi)專家表示,界定AI謠言產(chǎn)生是否存在主觀惡意,、認定被造謠方損失等存在一定困難,對AI造謠等行為在刑事處罰上容易出現(xiàn)法律適用難題,,導致打擊效果難以落地?!拔覀冄芯堪l(fā)現(xiàn),,在86起涉AI造謠相關(guān)案件中,懲處類型為刑事處罰的占比僅為15.66%?!鄙蜿栒f。

北京孟真律師事務所律師舒勝來認為,,面對AI謠言等技術(shù)和犯罪形式的快速迭代,,法律法規(guī)研究也要與時俱進。要進一步明確AI造謠犯罪的認定標準,,加強行刑銜接,對AI造謠者“精準懲處”,,做到罰當其罪、罰當其過,,為廣大網(wǎng)民營造風清氣正的網(wǎng)絡空間。

(編輯:鳴嫡 )

“護眼臺燈”亂象調(diào)查

“護眼臺燈”亂象調(diào)查 AI賬號成起號新套路 多手段繞過“AI打標”背后有哪些隱患,?

AI賬號成起號新套路 多手段繞過“AI打標”背后有哪些隱患,? 救命的醫(yī)療設備,,如何淪為個人提款機?

救命的醫(yī)療設備,,如何淪為個人提款機? 原價上千元“貴婦霜”網(wǎng)店賣不到百元

原價上千元“貴婦霜”網(wǎng)店賣不到百元